“我们相信,SceneScript代表了真正AR眼镜道路上的一个重要里程碑,它将架起物理世界和数字世界的桥梁。”

Reality Labs Research日前发布了一段45秒视频,并展示了未来的眼镜是如何捕获点云,而基于Llama AI的SceneScript模型又是如何将其解释为可识别的现实世界对象,如墙壁、窗户、门和家具。显然,团队希望向我们展示AI和AR结合的未来一督。

团队表示,SceneScript能够使用端到端机器学习直接推断房间的几何形状,并使用语言表示它。与以前的方法相比,这种方法产生了紧凑、完整、可解释和可扩展的物理场景表示。

最令人印象深刻的是,SceneScript可以创建复杂的几何形状,使得桌子、办公椅和沙发有了更多的细节。

想象一下,一副时尚、轻便的眼镜,它结合了情境化人工智能和显示屏,可以在你需要的时候无缝地为你提供实时信息,并在你的日常生活中主动提供帮助。为了将这样一副AR眼镜变成现实,系统必须能够理解你的物理环境的布局以及世界是如何在3D中形成。这种理解可以允许AR眼镜为你和你的个人环境量身定制内容,比如无缝地将数字覆盖与你的物理空间融合在一起,或者为你提供转弯方向,帮助你在不熟悉的地方导航。

然而,构建3D场景表示是一项复杂的任务。目前像Meta Quest 3这样的MR头显基于来自摄像头或3D传感器的原始视觉数据创建物理空间的虚拟表示。其中,原始数据转换成一系列形状,并描述环境的不同特征,如墙壁、天花板和门。通常,系统依赖于预定义的规则将原始数据转换为形状。然而,这种启发式方法经常会导致错误,特别是在具有独特或不规则几何形状的空间中。

所以,Reality Labs Research发布了SceneScript,一种生成场景布局和使用语言表示场景的新方法。

不是使用硬编码规则将原始视觉数据转换为房间建筑元素的近似值,团队训练SceneScript使用端到端机器学习直接推断房间的几何形状。

这使得物理场景的表示非常紧凑,将内存需求减少到只有几个字节。另外,物理场景的表示非常完整,可产生清晰的几何形状,类似于可缩放的矢量图形。重要的是,它是可解释的,这意味着我们可以很容易地阅读和编辑相关表示。

如何训练SceneScript?

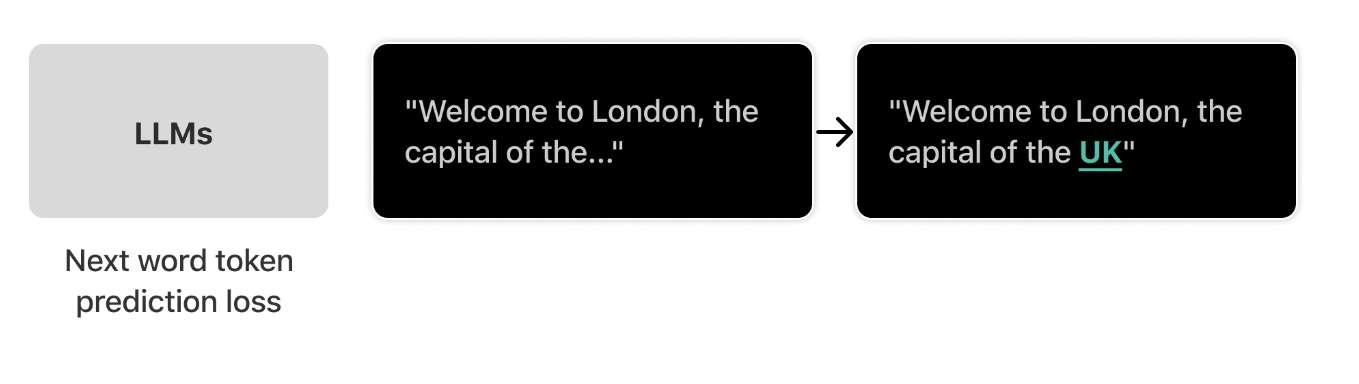

像Llama这样的大型语言模型使用一种称为下一个令牌预测的技术进行操作。其中,人工智能模型根据句子中的下一个单词来预测句子中的下一个单词。例如,如果你输入“猫坐在……”时,模型会预测下一个单词可能是“地板”或“毛毯”。

SceneScript利用了下一个令牌预测的相同概念。然而,SceneScript模型不是预测通用语言标记,而是预测下一个建筑标记,例如“墙”或“门”。

通过向网络提供大量的训练数据,SceneScript模型学习如何将视觉数据编码为场景的基本表示,然后它可以将其解码为描述房间布局的语言。这允许SceneScript从可视化数据中解释和重建复杂的环境,并创建有效描述其分析的场景结构的文本描述。

然而,团队需要大量的数据来训练网络,并教导它物理空间的典型布局方式。同时,团队需要保护隐私。显然,这是一个的挑战。

在模拟中训练SceneScript

SceneScript团队没有依赖于物理环境的数据,而是创建了一个室内环境的合成数据集Aria Synthetic Environments。这个数据集包括100000个完全独特的室内环境,而每个环境都使用SceneScript语言进行描述,并与每个场景的模拟视频配对。

然后,通过每个场景渲染的视频使用与Project Aria相同的传感器特性进行模拟。这种方法允许在保护隐私的同时,在模拟中完全训练SceneScript模型。接下来,可以使用Project Aria眼镜来验证模型,并确认模型具有将其泛化到实际环境的能力。

扩展SceneScript来描述对象、状态和复杂的几何形状

SceneScript的另一个优点是它的可扩展性。

只需在Aria Synthetic Environments中为描述门的场景语言添加一定的额外参数,就可以训练网络准确预测物理环境中门的打开或关闭程度。

另外,通过向体系结构语言添加新特性,系统可以准确地预测对象的位置,并进一步将对象分解为它们的组成。

例如,沙发可以在SceneScript语言中表示为一组几何形状,包括靠垫、凳腿和扶手。这种细节水平最终可以帮助设计师创建真正针对各种物理环境定制的AR内容。

加速增强现实,推动LLMs,人工智能和机器学习研究的发展

Meta表示,SceneScript可以解锁MR头显和未来AR眼镜的关键用例,比如生成为视障人士提供逐步导航所需的地图,。

SceneScript同时为LLMs提供了对物理空间进行推理所需的词汇表,而这可能最终释放下一代数字助理的潜力,为它们提供必要的物理世界背景,以回答复杂的空间查询。

他们总结道:“我们相信,SceneScript代表了真正AR眼镜道路上的一个重要里程碑,它将架起物理世界和数字世界的桥梁。当Reality Labs Research深入研究这一潜力时,我们对这种开创性方法将如何帮助塑造人工智能和机器学习研究的未来前景感到兴奋。”

来源链接:https://news.nweon.com/119142